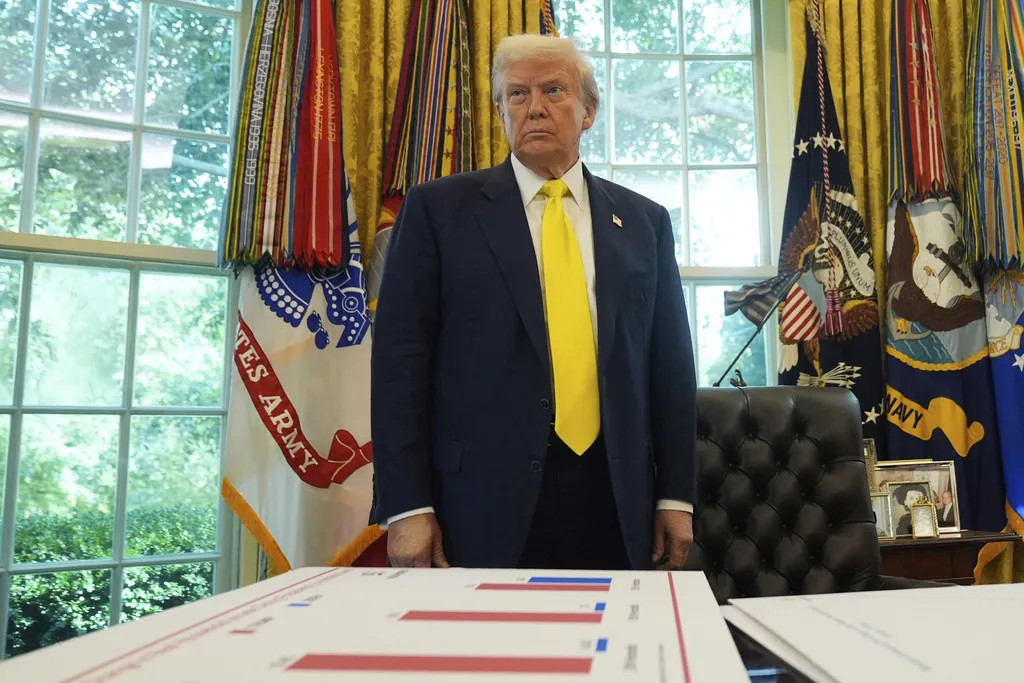

Predsjednik Donald Trump izjavio je u utorak da je video koji se širi internetom, a prikazuje predmete koje se bacaju kroz prozor na gornjem spratu Bijele kuće, kreiran pomoću umjetne inteligencije, iako je njegov tim za medije nekoliko sati ranije potvrdio autentičnost snimka.

Izgleda da je umjetna inteligencija postala nova “lažna vijest”.

Kriviti AI postaje sve popularnija strategija političara koji žele izbjeći odgovornost za nešto neugodno. AI, na kraju krajeva, nije osoba. Ne može objaviti informacije niti podnijeti tužbu. Ali može praviti greške, što stvara problem vjerodostojnosti i otežava razlikovanje činjenica od fikcije u eri dezinformacija i manipulacija.

Kada je istina teško raspoznatljiva, neistinita strana profitira, kažu analitičari. Ovaj fenomen je poznat kao “dividenda lažova”.

U utorak je predsjednik Trump podržao takvu praksu. Upitan o viralnom snimku koji prikazuje nekoga kako nešto baca kroz prozor Bijele kuće na gornjem spratu, predsjednik je odgovorio: "Ne, to je vjerovatno AI" — nakon što je njegov tim za medije ranije naznačio novinarima da je video autentičan, piše Euronews.com.

Međutim, Trump, poznat po insistiranju da je istina ono što on kaže, odlučno se priključio fenomenu krivnje AI-a.

"Ako se dogodi nešto zaista loše", rekao je novinarima, "možda ću jednostavno morati kriviti AI".

Nije sam u tome.

AI se krivi — ponekad opravdano, ponekad ne

Istog dana u Caracasu, venezuelanski ministar komunikacija Freddy Ñáñez dovodio je u pitanje vjerodostojnost videa američke administracije koji je navodno prikazivao američki napad na brod u Karibima, u kojem je cilj bila venezuelanska kriminalna grupa Tren de Aragua, a 11 ljudi je poginulo.

Video napada objavljen na Truth Socialu prikazuje dug, višemotorni brod na moru kada iznenada izbije bljesak svjetla. Brod je zatim nakratko obavijen plamenom.

"Na osnovu dostavljenog videa, vrlo je vjerovatno da je kreiran pomoću umjetne inteligencije", napisao je Ñáñez na svom Telegram nalogu, opisujući "gotovo crtačko animiranje".

Ponekad je kriviti AI čak i kompliment. ("On je kao igrač generisan AI-jem", rekao je teniser Alexander Bublik za svog protivnika na US Openu Jannika Sinnera). Ali kada moćnici koriste ovu strategiju, stručnjaci upozoravaju da može biti opasna.

Stručnjak za digitalnu forenziku Hany Farid godinama je upozoravao na rastuće sposobnosti AI "deepfake" slika, glasova i videa u cilju prevara ili političkih dezinformacija, ali uvijek je ukazivao i na dublji problem.

"Uvijek sam tvrdio da je veći problem taj što kada uđete u svijet gdje bilo šta može biti lažno, onda ništa ne mora biti stvarno", rekao je Farid, profesor na Univerzitetu Kalifornija u Berkeleyju. "Možete negirati bilo koju stvarnost jer sve što trebate reći je: ‘To je deepfake.’"

Prije desetak ili dvadeset godina to nije bio slučaj. Trump se rijetko izvinjavao, kao 2016. za komentare o dodirivanju žena bez njihovog pristanka na notornom snimku "Access Hollywood". Njegova protivnica, demokrata Hillary Clinton, rekla je da je pogriješila nazivajući neke njegove pristalice "korpom odvratnih".

Toby Walsh, glavni naučnik i profesor AI na Univerzitetu New South Wales u Sydneyju, kaže da krivnja AI-a stvara probleme ne samo u digitalnom svijetu, već i u stvarnom životu.

"To vodi u mračnu budućnost u kojoj više ne držimo političare (ili bilo koga drugog) odgovornim", napisao je Walsh u e-mailu. "Prije je bilo tako da ako bi vas uhvatili na snimku kako nešto kažete, morali ste preuzeti odgovornost. Sada to više nije slučaj".

Razmišljanje o ‘dividendi lažova’

Danielle K. Citron s Pravnog fakulteta Univerziteta Boston i Robert Chesney s Univerziteta Texas predvidjeli su ovaj problem u istraživanju objavljenom 2019. godine, gdje opisuju fenomen koji nazivaju "dividenda lažova".

"Ako javnost izgubi vjeru u ono što čuje i vidi, i istina postane stvar mišljenja, moć prelazi onima čija su mišljenja najistaknutija — što dodatno jača autoritete", napisali su u časopisu California Law Review.

"Skeptična javnost bit će sklona sumnjati u autentičnost stvarnih audio i video dokaza."

Istraživanja pokazuju da mnogi Amerikanci sumnjičavo gledaju na AI. Otprilike polovina odraslih u SAD-u rekla je da ih povećana upotreba AI-a u svakodnevnom životu čini "više zabrinutima nego uzbuđenima", prema anketi Pew Research Centra iz augusta 2024.

I imaju razloga, a Trump je odigrao značajnu ulogu u narušavanju povjerenja i istine.

Trumpova historija dezinformacija i čak laži radi vlastite naracije prethodi AI-u. Poznat je po korištenju izraza "lažne vijesti", pojma koji sada označava skepticizam prema izvještajima medija. Leslie Stahl s CBS-ovog “60 Minutes” rekla je da joj je Trump 2016. neformalno rekao kako nastoji "diskreditovati" novinare kako njihovi negativni izvještaji ne bi bili dobili povjerenje javnosti.

Trumpova tvrdnja u utorak da je AI odgovoran za video iz Bijele kuće nije bila njegov prvi pokušaj da krivi umjetnu inteligenciju. 2023. je tvrdio da je anti-Trump grupa Lincoln Project koristila AI u videu kako bi ga "prikazala lošim".

U spotu pod nazivom "Feeble", ženski narator ismijava Trumpa: "Hej Donald... slab si. Izgledaš nesigurno. Treba ti pomoć da se krećeš". Pitanje je bilo njegova "muževnost", uz prikaz dvije plave pilule. Video se nastavlja snimcima Trumpa koji se spotiče dok govori.

"Perverznjaci i gubitnici iz propalog i nekada raspuštenog Lincoln Projecta i drugi koriste AI (umjetnu inteligenciju) u svojim lažnim televizijskim reklamama kako bi me prikazali lošim i patetičnim kao Pokvareni Joe Biden", napisao je Trump na Truth Socialu.

Lincoln Project je tada Associated Pressu izjavio da AI nije korišten u spotu.